Por Redacción:

Ciudad de México, 29 de agosto de 2025. Google convirtió a Gemini en un taller creativo de ida y vuelta: su nuevo modelo de imagen Gemini 2.5 Flash Image, conocido internamente como “nano-banana”, ya está integrado en la app y permite subir una foto, describir con lenguaje natural lo que quieres cambiar y seguir puliendo la imagen por turnos, sin perder el parecido de personas, mascotas u objetos entre edición y edición. La compañía lo presentó como el modelo de generación y edición más ambicioso de su suite; en su propio anuncio lo define —con nombre y apodo— y detalla funciones como fusión de varias imágenes en una, transformaciones dirigidas por texto y aplicación del “conocimiento del mundo” de Gemini para entender y modificar escenas con precisión.

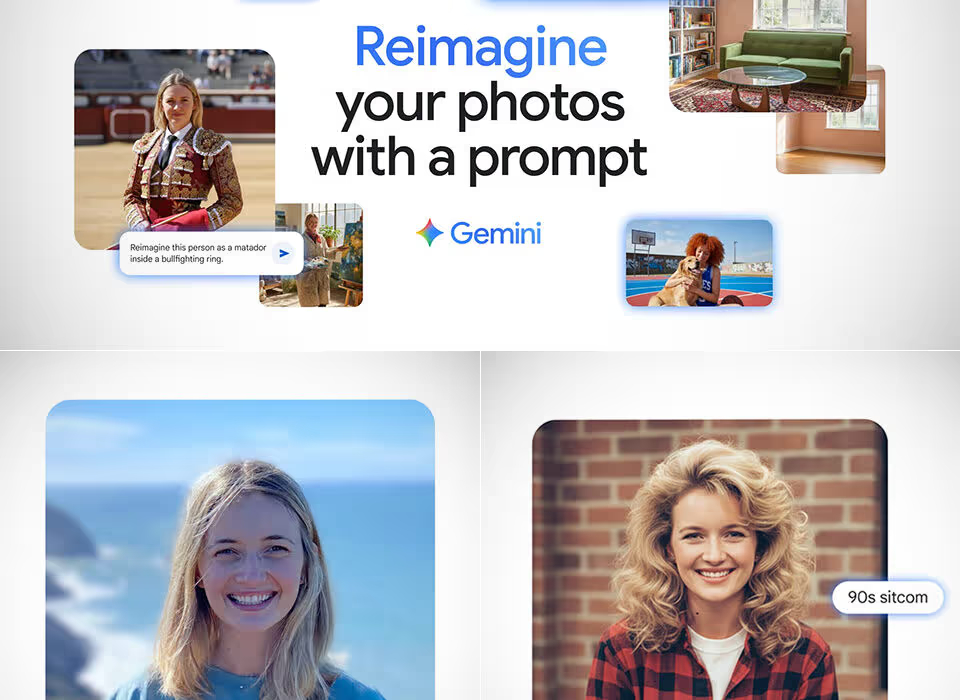

El aterrizaje no es un rumor: Google dice que ya puedes probar la edición actualizada “desde hoy” en la app y la web de Gemini, con ejemplos oficiales de cambios de peinados, vestuarios y fondos, edición multitura (pintar paredes, añadir muebles, después ajustar sólo un detalle sin afectar lo demás) y mezcla de estilos (tomar la textura de una imagen y aplicarla a otra). En paralelo, medios tecnológicos confirman la disponibilidad para usuarios gratuitos y de pago y subrayan el salto de consistencia en retratos respecto a editores previos.

Bajo el cofre, “nano-banana” es la etiqueta que Google usa públicamente para este modelo, y el propio blog de desarrolladores lo nombra así (“aka nano-banana”): ahí enumera sus capacidades clave (consistencia de personajes, multi-image fusion y edición por instrucciones) y deja claro que el flujo está pensado para trabajo conversacional y creativo de varias iteraciones. También precisa disponibilidad para desarrolladores vía Gemini API, Google AI Studio y Vertex AI, con tarifa de referencia de 0.039 dólares por imagen (1290 tokens de salida).

Como respuesta a los riesgos de manipulación visual, Google afirma que todas las imágenes creadas o editadas con este modelo llevan una marca de agua visible y la marca digital invisible SynthID, de DeepMind, para identificar contenido generado o retocado por IA. Esta salvaguarda aparece tanto en el comunicado de producto de Gemini como en el blog para desarrolladores.

La propia compañía presume que el modelo es el mejor valorado en el “leaderboard” de LMArena para edición de imágenes, y prensa especializada como TechCrunch, Ars Technica y Axios lo presenta como el movimiento con el que Google busca ponerse al frente en edición con IA: no sólo genera imágenes, edita con control fino, mantiene identidades entre cambios y combina fotos con resultados más estables que en ciclos anteriores. Incluso Sundar Pichai alimentó el guiño del nombre con tres emojis de plátano al anunciar el despliegue.

Para el usuario común, la experiencia es la de un estudio de diseño dialogado: cargas tu foto, pides “ponme un traje de los 90 sin tocar la cara”, “mezcla esta habitación con el estilo de este catálogo”, “pega a mi perro en este paisaje y deja su pelaje igual”, y Gemini iterará contigo hasta pulir el resultado. Para equipos creativos, el valor está en consistencia de marca (misma persona u objeto en múltiples escenarios) y en acelerar bocetaje y versiones sin salir de la conversación. Todo esto se puede probar desde la app y el sitio de Gemini y, si se quiere construir sobre ello, en Google AI Studio con plantillas listas para “remixar” y desplegar.